Fünf fiktive Headlines zu KI und ihr Wahrheitsgehalt

Der IT-Dienstleister adesso hat mal einen ganz anderen Blick in die Glaskugel geworfen. Er hat sich fünf fiktive Headlines zum Thema KI ausgedacht und sie gleich auf ihren Wahrheitsgehalt überprüft:

- „GenAI fegt wie ein Hurrikan durch die Arbeitswelt – kein Job ist sicher.“

Wahrheitsgehalt: 50 Prozent – die Arbeitswelt wird dynamischer, aber nicht von der KI dominiert.

Erklärung: GenAI wird zweifellos zum Game-Changer. Von der automatisierten Vertragsgestaltung bis zur Echtzeitanalyse von Geschäftsdaten – die Einsatzmöglichkeiten sind nahezu unbegrenzt. Doch bedeutet das wirklich eine Revolution? Fakt ist: Berufe und Arbeitsprofile entwickeln sich seit jeher weiter. Vor zwei Jahrzehnten klangen Jobtitel wie Social-Media-Manager oder Big-Data-Analyst exotisch. Neue Rollen und andere Aufgabengebiete gehören zur Arbeitswelt jedoch dazu. Das war nie anders und ist bei jedem technologischen Umbruch so. Eine komplette Neuordnung? Wohl kaum. Aber spannend bleibt es allemal. - „Softwareentwicklung braucht keine menschliche Expertise mehr.“

Wahrheitsgehalt: 30 Prozent – GenAI kann viele Routineaufgaben übernehmen, aber menschliche Expertise nicht ersetzen.

Erklärung: Die Propheten der Automatisierung hatten es so schön prognostiziert: Code schreiben, Bugs beheben, Anwendungen bauen – all das sollte mit GenAI wie von Zauberhand gehen. Doch die Realität sieht anders aus. Die Technologie kann den Alltag von Entwicklern erleichtern, keine Frage. Aber kreative Problemlösungen, komplexe Architekturplanung und ein tiefes Verständnis der Anforderungen – das bleibt eine ureigene menschliche Domäne. Fazit: Die KI ist ein Helfer, kein Zauberstab. - „GenAI ist ein Kinderspiel – alles andere ist Schwarzmalerei.“

Wahrheitsgehalt: 20 Prozent – die Umsetzung von Projekten wird einfacher als früher, ist aber nach wie vor kein Selbstläufer.

Erklärung: Die Illusion eines einfachen GenAI-Projekts verflüchtigt sich schnell. Wer geglaubt hat, mit ein paar Mausklicks die digitale Transformation abzuschließen, wird 2025 eines Besseren belehrt. Denn: Das A in GenAI steht nicht für Abrakadabra, sondern für Arbeit. Daten aufbereiten, Modelle trainieren, Ergebnisse überwachen – der Weg ist steinig, aber er lohnt sich. Der Aufwand zahlt sich aus, wenn die Technologie effizient eingesetzt wird. - „Der Nobelpreis für Literatur geht an OpenAI.“

Wahrheitsgehalt: 5 Prozent – immerhin hat Bob Dylan den Nobelpreis schon einmal gewonnen.

Erklärung: KI-Fans hatten es fest ge-

glaubt: Der erste Nobelpreis für einen Algorithmus ist nur eine Frage der Zeit. Doch auch 2025 bleibt die Literaturszene von Menschen dominiert. Warum? Weil wahre Kreativität mehr ist als das Aneinanderreihen von Wahrscheinlichkeiten. Ohne Intuition, Emotion und Lebenserfahrung bleibt GenAI zwar ein genialer Nachahmer, aber kein echter Künstler. Kurz: Das gewisse Etwas lässt sich nicht in Code gießen. - KI erlangt eigenes Bewusstsein.“

Wahrheitsgehalt: 0 Prozent – GenAI ist und bleibt ein Werkzeug.

Erklärung: Beruhigende Nachrichten für

Skeptiker: Die Dystopie allmächtiger Maschinen bleibt auch in diesem Jahr Science-Fiction. GenAI hat weder ein Bewusstsein noch eigene Ziele – sie ist und bleibt ein Werkzeug. Vielmehr profitieren die Anwendungen von der allgegenwärtigen Tendenz zur Anthropomorphisierung, also der Vermenschlichung der Technik. Die Gefahr liegt woanders: Nicht die KI selbst ist das Problem, sondern ihr potenzieller Missbrauch durch den Menschen. Klare Regeln und eine verantwortungsvolle Kontrolle sind daher unerlässlich.

Professor Dr. Volker Gruhn, Gründer und Vorsitzender des Aufsichtsrats der adesso SE, kommentiert das Gedankenspiel um die Headlines folgendermaßen: „Was uns in Sachen GenAI in Zukunft tatsächlich erwartet, lässt sich schwer abschätzen. Statt unrealistischen Versprechungen nachzujagen, sollten sich die Unternehmen also auf das Hier und Jetzt konzentrieren. Schließlich erleben wir mit GenAI gerade einen spannenden Technologiesprung – nicht mehr und auch nicht weniger.“

Fast jeder zehnte Studierende schreibt die Abschlussarbeit vollständig mit ChatGPT

Künstliche Intelligenz ist längst im akademischen Alltag angekommen. Laut einer aktuellen Umfrage der Hochschul-App UniNow unter knapp 6000 Studierenden setzen bereits 9 Prozent vollständig auf KI-Tools wie ChatGPT bei der Erstellung ihrer Abschlussarbeiten. Weitere 35 Prozent verwenden KI gezielt für einzelne Aufgaben wie Recherche oder das Überwinden von Schreibblockaden. Diese Zahlen zeigen: Während KI für viele Studierende ein hilfreiches Werkzeug ist, bleibt sie für andere ein Tabu. Ein Drittel der Befragten verzichtet komplett auf den Einsatz solcher Technologien – sei es aus Skepsis gegenüber der Zuverlässigkeit oder aus Sorge um die wissenschaftliche Integrität.

Die Ergebnisse der Umfrage werfen wichtige Fragen auf: Wie viel Unterstützung durch KI ist in der Wissenschaft vertretbar? Und welche Kompetenzen sollten Studierende erwerben, um den verantwortungsvollen Umgang mit dieser Technologie zu erlernen? Klar ist: KI wird nicht nur den Studienalltag, sondern auch die Arbeitswelt grundlegend verändern. Unternehmen sollten diese Entwicklung nutzen, um Mitarbeitende frühzeitig auf den Umgang mit Schlüsseltechnologien vorzubereiten.

Unternehmen erwarten 2025 erhöhte Technologiebudgets

Apptio, ein IBM-Unternehmen, veröffentlichte eine neue globale Studie, die untersucht, wie Unternehmen ihre Technologieausgaben und Investitionsprioritäten steuern. Die Umfrage, an der mehr als 1.000 Technologie-Entscheidungsträger aus Nordamerika, Europa, dem asiatischpazifischen Raum und Lateinamerika teilgenommen haben, untersucht, wie Tech-Führungskräfte unter dem Einfluss der Einführung von KI die Art und Weise ändern, wie sie ihre Technologieausgaben betrachten. Demnach erwarten in diesem Jahr mehr als 90 Prozent der Unternehmen eine Erhöhung ihrer Technologiebudgets zur Unterstützung der bestehenden Infrastruktur, zur Aufrechterhaltung der betrieblichen Grundlagen und zur Förderung neuer Geschäfte durch Innovationen.

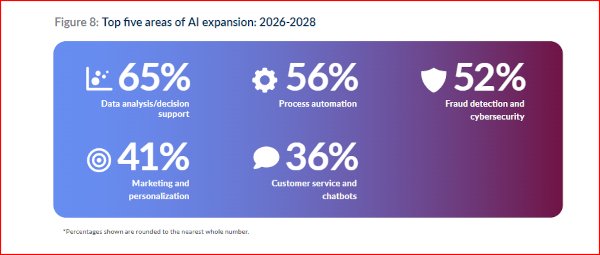

Mehr als die Hälfte (55 Prozent) der Führungskräfte verfügt jedoch nicht über ausreichende Informationen, um Technologieausgaben effektiv zu bewerten, und drei Viertel (75 Prozent) der Unternehmen besitzen noch keinen soliden ROI für den Nachweis ihrer Cloud-Transformationen. Der Einsatz von KI nimmt rapide zu, wobei Datenanalyse (71 Prozent), Prozessautomatisierung (55 Prozent) und Cybersicherheit (46 Prozent) derzeit die wichtigsten Anwendungsfälle sind.

Um die wachsenden Investitionen in KI-Initiativen zu rechtfertigen, müssen die Führungskräfte den ROI bewerten, indem sie die Umsatzsteigerung (90 Prozent), die betriebliche Effizienz (86 Prozent) und die verbesserte Entscheidungsfindung (84 Prozent) quantifizieren. Gelingt ihnen das, können sie künftigen Budgeterhöhungen zuversichtlich entgegensehen.

Forschung über digitale Demokratie soll Bürgerbeteiligung verbessern

Die digitale Gesellschaft transformiert die Demokratie. Immer häufiger werden digitale Technologien und das Internet genutzt, um demokratische Prozesse zu unterstützen und zu verbessern – die Rede ist von digitaler Demokratie. Sie beschreibt die Potenziale moderner Technologien für die Förderung demokratischer Werte und Praktiken sowie die Verwendung digitaler Medien für politische Information und Kommunikation, politische Beteiligung, Wahlen, zivilgesellschaftliches Engagement, Aktivismus oder auch die Förderung politischer Bildung.

Um den positiven Wandel voranzutreiben, haben sich elf europäische Partner im internationalen und interdisziplinären EU-Forschungsprojekt INNOVADE („IN-NOVAtive DEmocracy through digitalisation“) zusammengetan (siehe Foto), darunter auch die Universität Paderborn. Die digitale Demokratie strebt danach, die Bürgerbeteiligung an politischen Prozessen zu erweitern, politisches Handeln transparenter zu gestalten und Regierungs- und Verwaltungsprozesse zu vereinfachen. Daher wird INNOVADE unter anderem die „Digital Democracy App“ entwickeln, die Bürgerinnen und Bürger dabei unterstützt, sich mit der lokalen Regierung auseinanderzusetzen, ihre Ideen zu teilen und einen echten Einfluss auf die Entscheidungen zu nehmen, die ihren Alltag betreffen.

Ziel des Projekts ist es, die digitale Demokratie besser zu verstehen und zu fördern. Ein Team des Instituts für Medienwissenschaften an der Universität Paderborn spielt bei INNOVADE eine wichtige Rolle: Prof. Dr. Christian Fuchs, Leiter des Arbeitsbereichs Mediensysteme und Medienorganisation, verantwortet gemeinsam mit Dr. Banu Durdag und Forschungsassistent Kevin Friesch die sozialwissenschaftliche Grundlagenforschung über digitale Demokratie. „INNOVADE analysiert Prinzipien und Möglichkeiten der Stärkung der digitalen Demokratie sowie Hindernisse und Risiken. Das hochaktuelle Vorhaben adressiert ein zentrales gesellschaftspolitisches Thema der heutigen Zeit“, sagt Fuchs zum Horizon Europe Projekt.

Die EU fördert INNOVADE seit Anfang Januar für eine Dauer von drei Jahren mit rund drei Millionen Euro. Horizon Europe ist aktuell das wichtigste Förderprogramm der EU für Forschung und Innovation.

CIOs und CTOs sehen Agentic AI als zentralen Faktor für IT-Operations

PagerDuty hat den „State of Digital Operations 2025 Report“ veröffentlicht. Für den Bericht wurden 1.100 Führungskräfte im Bereich IT-Operations aus Nordamerika, Europa – darunter auch Deutschland –, dem Nahen Osten und Afrika (EMEA) sowie dem asiatisch-pazifischen Raum und Japan (APJ) befragt. Die Ergebnisse belegen die positive Dynamik, die Künstliche Intelligenz (KI) und Automatisierung auf die geschäftlichen Auswirkungen haben. Sie zeigen zudem, dass die Top-Prioritäten für den IT-Betrieb 2025 Effizienz, Sicherheit und Innovation sind. Die Befragten gaben an, dass sich die operative Belastbarkeit deutlich verbessert hat, die Automatisierung effizienter genutzt wird und sich die Zeit für Markteinführungen verkürzt hat.

Die wichtigsten Ergebnisse des Reports: 64 Prozent der Befragten rechnen damit, dass die Budgets für den IT-Betrieb bis 2025 steigen werden. 88 Prozent der Befragten sind der Meinung, dass autonome und selbstlernende KI (Agentic AI) in den nächsten ein bis zwei Jahren eine zentrale oder unterstützende Rolle spielen wird.

53 Prozent der CIOs und CTOs betrachten Agentic AI als zentralen Bestandteil für künftige IT-Prozesse: Die regionalen Unterschiede sind beachtlich. Im asiatisch-pazifischen Raum und Japan (APJ) sehen 46 Prozent der Befragten Agentic AI als entscheidend für die Zukunft des IT-Betriebs an. Sie liegen damit leicht über dem Wert für Nordamerika (42 Prozent) und deutlich über dem Wert für EMEA (33 Prozent).

Die wichtigsten Hindernisse für eine breitere Erfahrung bei der Automatisierung sind bislang Sicherheitsrisiken (das nennen 35 Prozent der Befragten) sowie der Fachkräftemangel in der IT.

Generative KI verändert die Bedingungen für Cybersicherheit

GenAI vergrößert einerseits Schwachstellen, andererseits erwartet mehr als jedes zweite Unternehmen, Bedrohungslagen durch die Technologie schneller zu erkennen und Fehler zu vermeiden. Das zeigt die Studie „New defenses, new threats: What AI and GenAI bring to cybersecurity“ des Capgemini Research Institute.

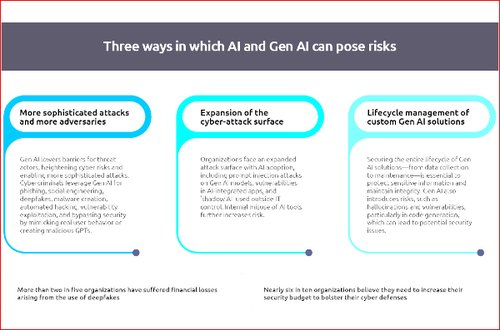

Der Studie an über 1000 Organisationen in 13 Ländern zufolge betrachten Organisationen KI zwar als Technologie mit strategischer Bedeutung für die Stärkung ihrer Cybersicherheitsstrategien, doch die großflächige Einführung von GenAI in den verschiedensten Branchen führt gleichzeitig zu einer erhöhten Vulnerabilität. Generative KI bringt für Organisationen drei große Risikofelder mit sich: ausgefeiltere Angriffe durch eine größere Anzahl von Akteuren, eine wachsende Angriffsfläche und die Zunahme von Schwachstellen im gesamten Lebenszyklus individueller GenAI-Lösungen. Missbrauch von KI und generativer KI durch Mitarbeitende verschärft die Situation und kann das Risiko für Datenlecks signifikant steigern.

Nahezu alle befragten Organisationen (97 Prozent) berichten von Sicherheitsverstößen oder -problemen im Zusammenhang mit dem Einsatz generativer KI im vergangenen Jahr. GenAI birgt darüber hinaus neue Risiken wie Halluzinieren und das Generieren voreingenommener, schädlicher oder unangemessener Inhalte sowie Angriffe durch Prompt Injection, die Manipulation des Ausgabeverhaltens von KI- und GenAI-Modellen. Zwei von drei Organisationen (67 Prozent) befürchten Data Poisoning und den Verlust sensibler Daten über Datensätze, die zum Training von GenAI-Modellen verwendet werden.

Auch die Fähigkeit von generativer KI, hochrealistische synthetische Inhalte zu erzeugen, birgt neue Risiken: Mehr als zwei von fünf der befragten Organisationen (43 Prozent) geben an, infolge einer Deepfake-Attacke finanzielle Verluste erlitten zu haben. Fast 6 von 10 Unternehmen halten es für notwendig, ihr Cybersicherheitsbudget zu erhöhen, um ihre Abwehr entsprechend zu stärken.

KI und Gen AI unverzichtbar zur Angriffserkennung und Reaktion

Die Befragung von 1.000 Organisationen, die KI für ihre Cybersicherheit in Betracht ziehen oder bereits einsetzen, zeigt, dass die meisten dies tun, um ihre Daten-, Anwendungs- und Cloud-Sicherheit zu stärken. Denn dank dieser Technologie können sie riesige Datenmengen in kürzester Zeit analysieren, Muster erkennen und potenzielle Sicherheitsverletzungen vorhersagen.

Seit der Integration von KI in ihre Sicherheitskontrollzentren (Security Operations Centers, SOCs) haben mehr als 60 Prozent der Befragten die Dauer bis zur Erkennung von Angriffen um mindestens 5 Prozent verkürzt; fast 40 Prozent stellten eine um mindestens 5 Prozent reduzierte Behebungsdauer von Sicherheitsvorfäll